No! Questa non è una foto che ritrae due bambini palestinesi

Nel corso del conflitto tra Israele e Hamas, molte sono le immagini generate dall’Intelligenza Artificiale spacciate per vere al fine di influenzare gli utenti. Basti ricordare la fantomatica foto “scattata” in un magazzino di Hamas nell’ospedale di Shifa, quella del padre palestinese con i cinque figli e altre ancora. Nel corso degli ultimi giorni del 2023, è circolata una presunta foto raffigurante due piccolissimi bambini palestinesi che posano davanti alle macerie, sporchi e feriti, con i loro zaini come se andassero a scuola. In molti la spacciano come foto vera, ma c’è la “mano” dell’Intelligenza Artificiale. Per questa e altre verifiche vi suggeriamo i due speciali “Le bufale della propaganda pro Israele” e “Le bufale della propaganda pro Palestina“.

Per chi ha fretta

- L’immagine presenta alcuni errori tipici dell’Intelligenza Artificiale, come la generazione dei capelli e delle dita.

Analisi

Ecco un post Facebook di esempio con oltre 8 mila condivisioni:

Aprendo l’elenco delle condivisioni possiamo notare subito come questa immagine venga considerata come vera. Ecco un esempio:

Amorucci miei ,siete l esempio di tutti I bambini e ragazzi ,che non capiscono che i veri valori ,sono Ben altro ,possa geova mettere la sua mano sua su di voi

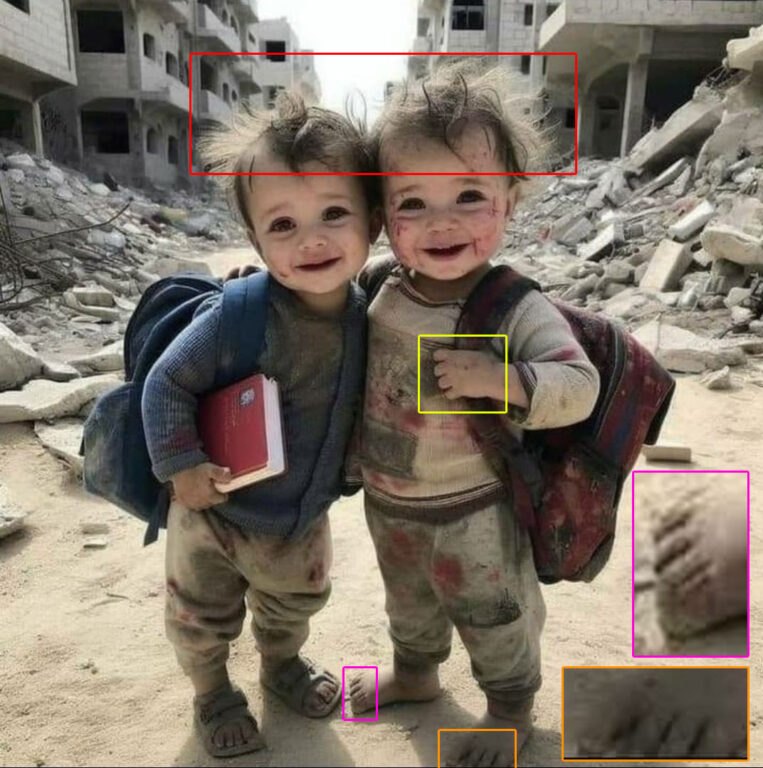

I classici segni dell’AI

Il primo segno che possiamo notare è l’effetto “rendering” dello sfondo. Le infrastrutture e le macerie sono molto lucide, un po’ come avviene nei videogiochi. Nell’immagine sottostante evidenziamo alcuni dei classici segni dell’AI.

Evidenziato in rosso troviamo i capelli. L’Intelligenza Artificiale ha la tendenza a generare pettinature con capelli fluttuanti (occhio allo strano ciuffo dietro il punto dove le due teste si “toccano”) e sfuocati. Entrambi i protagonisti sembrano avere lo stesso ciuffo frontale. Considerato che entrambi i soggetti sono molto simili in volto, è possibile che sia stata fatta la richiesta all’Intelligenza Artificiale di generare due fratelli.

Evidenziato in giallo troviamo la mano sinistra del soggetto a destra. Questa dovrebbe tenere lo zaino, che sembra molto pesante. La distanza tra pollice e indice risulta spropositata. Uno degli errori tipici dell’AI è la generazione delle dita, come possiamo vedere nei piedi del soggetto a destra, dove uno sembra avere sei dita (evidenziato in viola) contro quattro nell’altro (evidenziato in arancione).

Ulteriori analisi

Consapevoli dei falsi positivi forniti da alcuni tool online, abbiamo provato a sottoporre l’immagine a uno di questi. Il test evidenzia che dietro l’immagine ci sia l’AI, probabilmente Midjourney.

Su siti come Playgroundai.com troviamo molti esempi di immagini generate per raffigurare bambini palestinesi.

Alcune contengono errori molto evidenti, come bandiere sbagliate o fluttuanti. Come in quella dei due presunti bambini con lo zaino, molte sono quadrate e presentano l’effetto rendering dello sfondo.

Conclusioni

L’immagine diffusa ha un forte impatto emotivo, pertanto gli utenti tendono a non osservare i dettagli che evidenziano gli errori dell’Intelligenza Artificiale. Lo stesso vale per questa, che viene presentata come una foto vera e propria di due piccoli bambini palestinesi.

Questo articolo contribuisce a un progetto di Facebook per combattere le notizie false e la disinformazione nelle sue piattaforme social. Leggi qui per maggiori informazioni sulla nostra partnership con Facebook.