«Creato con AI» anche quando non lo è. La nuova etichetta di Meta fa infuriare i fotografi

All’inizio di febbraio, Meta aveva dichiarato che avrebbe iniziato a etichettare le foto create con strumenti di intelligenza artificiale sui suoi social network. In un paio di mesi, a maggio, il sistema di etichettatura è entrato a pieno regime ma non senza commettere errori grossolani. È questa la denuncia di numerosi fotografi che sulle piattaforme di Meta pubblicano il loro materiale, creato alla vecchia maniera con lenti ed obiettivi, che viene erroneamente flaggato come opera dell’intelligenza artificiale. Il fenomeno è particolarmente visibile su Instagram. Ad esempio, la foto pubblicata dal profilo ufficiale dei Kolkata Knight Riders squadra di cricket di Calcutta vincitrice del campionato nazionale indiano. Lo scatto in cui gli atleti esultano in una nube di fumo viola non convince il sistema di rilevamento di Meta, che vi applica il disclaimer «creato con IA», nonostante l’immagine sia una semplice fotografia. Attualmente l’avviso viene mostrato solo sulle app per dispositivi mobili, e non sul web.

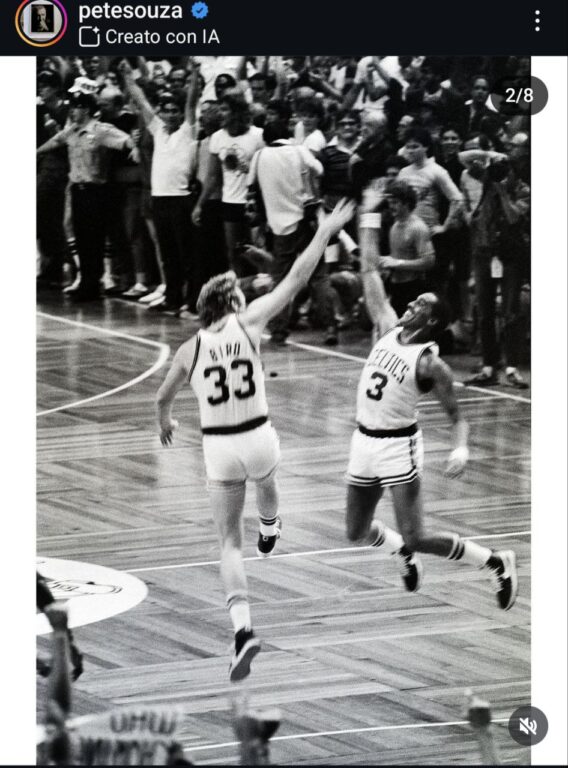

L’ex fotografo della Casa Bianca

La stessa sorte è toccata ad alcuni lavori dell’ex fotografo della Casa Bianca Pete Souza, che in un’intervista a Tech Crunch ha condiviso i suoi dubbi sulle ultime caratteristiche implementate dai software di elaborazione, come Adobe: «Con l’ultimo aggiornamento l’immagine viene “appiattita” prima di salvarla in formato Pdf, forse è questo a far rizzare le antenne del sistema di rilevamento di Meta». «Mi dà fastidio che l’app mi abbia obbligato a inserire l’etichetta anche se l’immagine non è creata con l’intelligenza artificiale», ha aggiunto riferendosi a uno scatto realizzato in uno storico match tra Boston Celtics ed LA Lakers oltre quarant’anni fa. Non si è fatta attendere a lungo la risposta di Meta alle critiche.

Come funziona il sistema di etichettatura

«Il nostro intento è sempre stato quello di aiutare le persone a sapere quando vedono contenuti realizzati con l’intelligenza artificiale. Stiamo tenendo conto dei feedback recenti e continuiamo a valutare il nostro approccio in modo che le nostre etichette riflettano la quantità di intelligenza artificiale utilizzata in un’immagine». Al di là degli errori, dunque, al momento la compagnia di Mark Zuckerberg sembra intenzionata a segnalare qualsiasi uso dell’AI, anche se parte di un banale fotoritocco, come potrebbe essere la rimozione di un elemento di disturbo sullo sfondo, o la correzione di un colore. Questo viene rilevato analizzando i metadati lasciati dai software generativi e di rielaborazione. Sebbene si tratti sicuramente del sistema che garantisce maggiore trasparenza, numerosi fotografi sostengono sarebbe necessario indicare se l’immagine è stata generata dall’AI, o solo modificata con essa, e se sì quale sia stato il suo impatto.