«Ci vuole una regola unica». Età minima per i social, Meta chiede che gli stessi standard europei siano validi per tutte le app (con verifica sullo store)

Meta ha lanciato un appello all’Unione Europea per chiedere una regolamentazione unica di app e social media per bambini e ragazzi. La compagnia proprietaria di Facebook, Instagram, WhatsApp e Threads chiede che vi sia una norma armonizzata a livello comunitario, che l’installazione di app per i minori di 16 anni sia approvata dai genitori, che gli app store possano verificare l’età di chi li usa e che vengano sviluppati degli standard per stabilire quali tipi di contenuti possono essere mostrati in base all’età dei destinatari. L’appello arriva dopo anni di dibattito diffuso sull’effetto che un accesso non supervisionato a Internet e ai social può avere sulla mente e sul comportamento di bambini e adolescenti.

Ansia, depressione e dipendenza da Instagram e i social

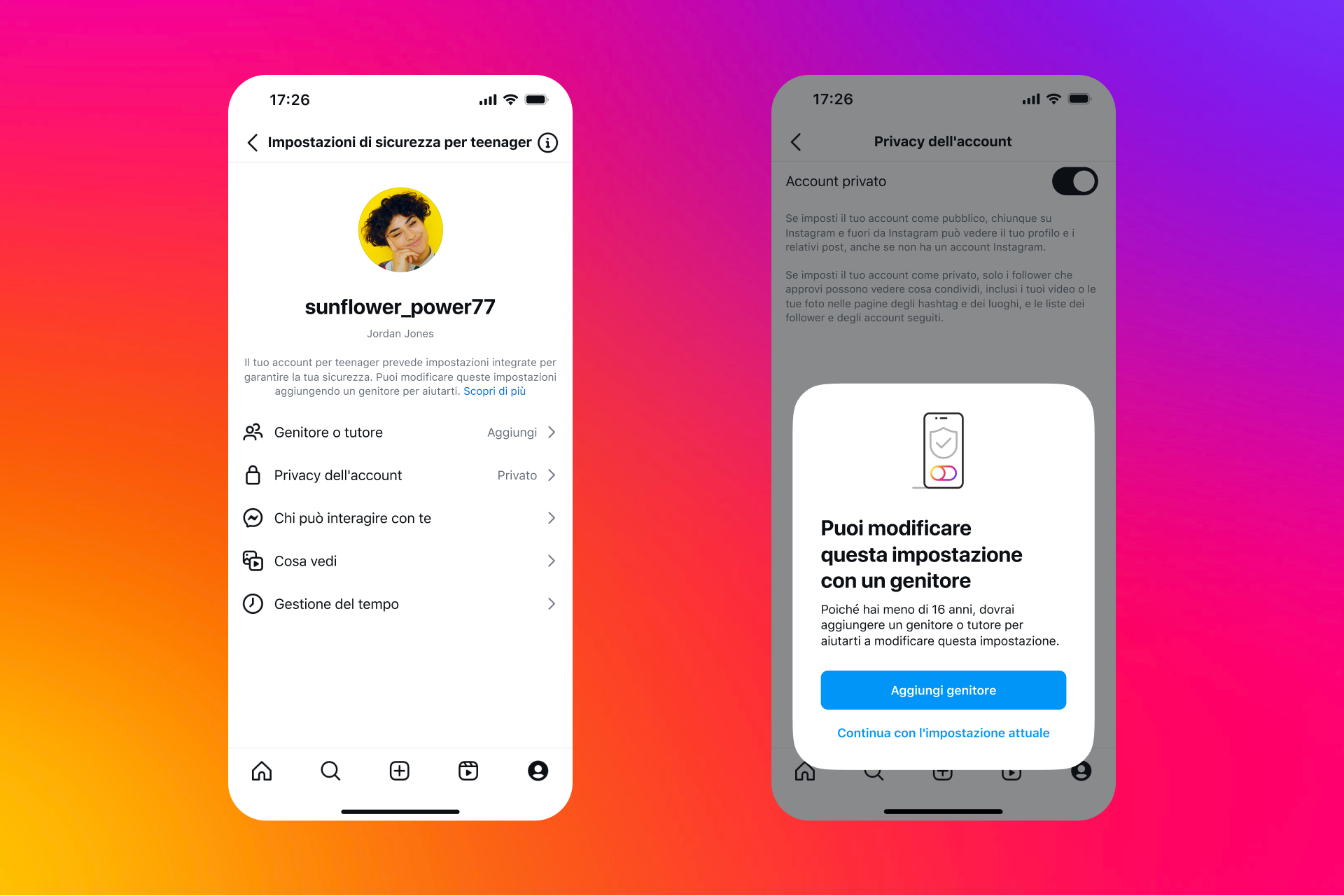

Nello specifico, Meta è stata accusata negli scorsi anni di essere a conoscenza di effetti pericolosi delle proprie piattaforme sui più giovani. Risultati che erano emersi anche da un report interno che aveva rilavato ansia e depressione correlati all’uso di Instagram degli adolescenti. Lo stesso era stato evidenziato da una ricerca dell’Unione Europea su Facebook e Instagram dalla quale affiorava che questi social possono creare dipendenza nei più giovani. Nei Facebook Papers rilasciati nell’ottobre del 2021, Frances Haugen, ex product manager dell’azienda aveva dichiarato che la compagnia avrebbe sempre messo il profitto di fronte ai problemi che le piattaforme di Meta causano negli utenti, nonostante ne fosse pienamente al corrente, sosteneva Haugen. In seguito ai report e alle accuse, Meta ha introdotto, nel novembre del 2022, una funzione che permette di verificare l’età degli utenti di Instagram a cui è seguito il lancio degli account specifici per teenager, che attualmente non sono ancora disponibili in Europa.

Giovani e social: la verifica dell’età nell’app store

Ora Meta chiede delle regole generali, che anziché essere applicate alle singole app, possano intervenire a monte. Negli app store. Ciò consentirebbe di non dover verificare la propria età su ciascuna applicazione, ma di farlo una volta soltanto. Con lo stesso sistema, potrebbero essere i genitori a dover autorizzare o meno il download di una nuova applicazione per i figli minori di 16 anni. Secondo i dati forniti da Menlo Park ci sarebbe ampio supporto da parte dei genitori europei per una misura di questo tipo. Dei 13 mila intervistati, il 68% degli italiani si augura che questo sistema venga implementato.

Gli standard sui contenuti per i giovani

Il meccanismo consentirebbe di non dover verificare l’età per ciascuna applicazione. A quel punto, suggerisce Meta, potrebbero essere creati degli standard europei su quale tipo di contenuto è adatto o meno a determinate fasce d’età. In maniera che ci siano delle linee guida che le numerose piattaforme online possa seguire. Il limite indicato dal Gdpr per l’accesso ai social è 16 anni. In Italia è 14 anni, ma verificarlo è attualmente molto difficile. Un tentativo in questo senso è quello della Francia, dove nel 2023 è stata presentata una proposta di legge che prevede multe e controlli per chi elude la verifica dell’età che spetterebbe alle piattaforme.