L’impatto dei fact-checker nelle Community Notes di X

La piattaforma X di Elon Musk, precedentemente nota come Twitter, basa la sua attività di verifica dei fatti su un programma di moderazione dei contenuti chiamato Community Notes, in cui gli utenti iscritti in forma anonima possono aggiungere ulteriore contesto sotto ai post. Le note inserite devono essere votate dai “verificatori anonimi” affinché vengano visualizzate al pubblico di X, ma il processo non è immediato e spesso capita che un contenuto non venga mai indicato come falso, nonostante la correttezza della verifica, concedendo terreno ai diffusori di fake news. Il sistema viene considerato alternativo alle organizzazioni di Fact-checking, come considerato da Meta dopo la vittoria elettorale di Donald Trump, che tuttavia non opera in totale trasparenza e non impone ai “verificatori anonimi” l’obbligo di rispettare rigorosi standard e codici etici nelle proprie verifiche. Eppure, come evidenziato da uno studio condotto dalla Fundación Maldita.es, il lavoro svolto dalle organizzazioni di Fact-checking risulta significativo e considerato affidabile dagli stessi “verificatori anonimi” del programma Community Notes.

Un terzo delle note citano le verifiche dei fact-checker

Secondo lo studio, condotto su 1.175.000 note della Community su X, sia visibili che non visibili, le organizzazioni di Fact-checking, in particolare quelle appartenenti all’European Fact-Checking Standards Network (EFCSN) e all’International Fact-Checking Network (IFCN), rappresentano la terza fonte più citata a livello globale, precedute solo dai post su X e da Wikipedia.

Per quanto riguarda i contenuti in lingua italiana, i fact-check pubblicati da Open e Facta.news rappresentano insieme la terza fonte più citata sempre dopo X e Wikipedia.

Lo studio evidenzia come le note che contengono un collegamento alle verifiche dei fact-checker vengono considerate più attendibili, aumentando la probabilità – e la velocità – con cui diventano visibili sotto i post contenenti informazioni fuorvianti o del tutto false.

Il problema dell’algoritmo ideologico

Il problema principale del programma Community Notes riguarda soprattutto la mancata visibilità di molte note, nonostante le verifiche corrette riportate al loro interno. Lo studio evidenzia che l’85% delle note che citano fonti indipendenti rimangono nascoste agli utenti a causa dell’algoritmo di X, che privilegia il «consenso tra iscritti con ideologie diverse» rispetto alla veridicità delle informazioni. Risulta evidente che se gli iscritti con ideologie diverse non concordano sul fact-check – spesso a causa dei propri bias – le note rimangono nascoste al pubblico, privilegiando l’informazione fuorviante o del tutto falsa.

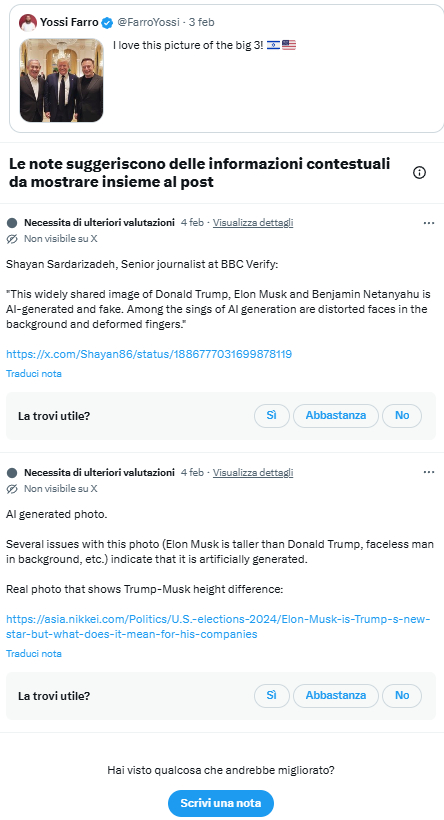

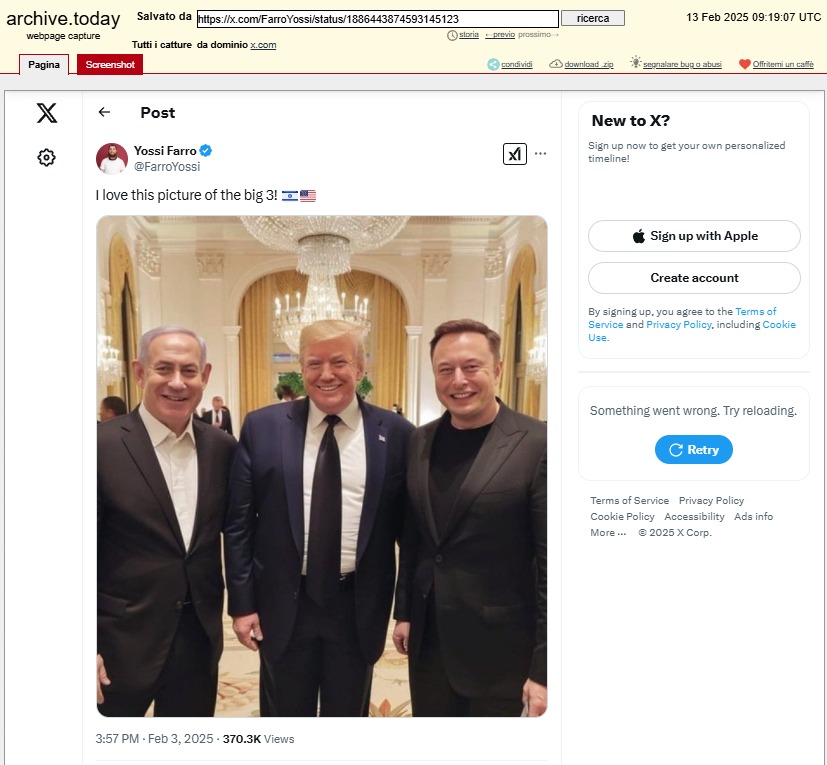

La foto generata con l’AI e le note non visibili

Lo scorso 3 febbraio 2025, l’utente X Yossi Farro ha condiviso un’immagine generata dall’Intelligenza Artificiale che ritrae Benjamin Netanyahu, Donald Trump ed Elon Musk. L’inesistente scatto fotografico, senza alcuna verifica, venne ripreso come veritiero da ANSA e da altri media. A distanza di una decina di giorni, i “verificatori anonimi” iscritti al programma Community Notes non sono ancora riusciti a rendere visibili le verifiche per segnalare il contenuto come falso. Ad oggi, infatti, non compare alcuna nota sotto al post (archiviato qui il 13 febbraio 2025).

Solo i “verificatori anonimi” possono visualizzare la richiesta di valutazione delle note finora inserite. Al momento, le uniche presenti citano il post X del collega di BBC Verify, Shayan Sardarizadeh, e un collegamento a una foto di Trump e Musk per evidenziare le differenze con l’immagine falsa. Entrambe le note riportano la data del 4 febbraio 2025.